2020年9月8日—Generation.利用RNN產生一個有結構的物件(structuredobject),像是一首詩或是一篇文章。句子是由『Word』或『Character』所組成,假設你有一個中文 ...,2021年1月24日—要達成這個目的,就要引入注意力機制,也就是我們說的RNNseq2seq+attention。RNNse...

從RNN 到Attention 演進

- acrobat distiller 6 0 下載

- exploring neural networks with activation atlases

- distill pub

- attention rnn

- exploring neural networks with activation atlases

- distill app

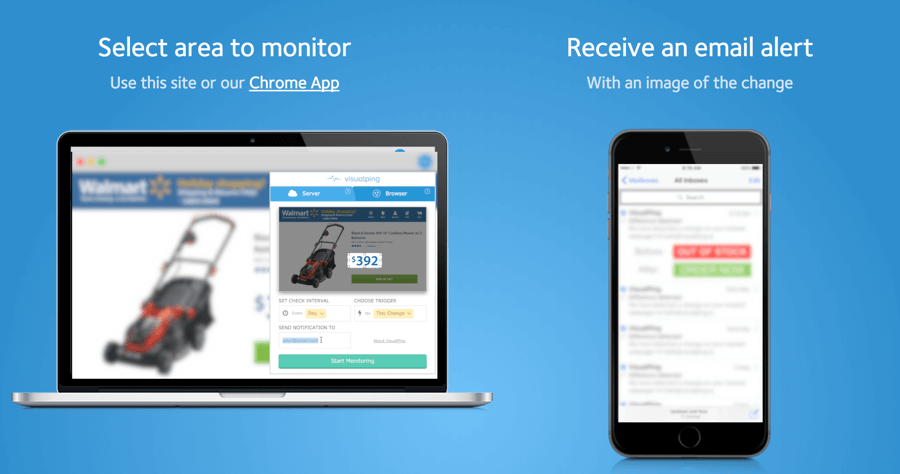

- website monitoring

- distilled

- distill web monitor教學

- distilled water

- distill pub

- chrome monitor

- distill pub

- distill research

- distilling中文

- distilled

- attention rnn

- activation atlas

- check4change chrome

- http distill pub 2016 misread tsne

- attention colah

- acrobat distiller 6 0

- distill feature visualization

- wachete

- distill web monitor

2021年5月1日—Attention機制(RNN+Attention).在Encoder-Decoder中,Encoder編碼得到序列特徵c,這組c包含序列中所有重要的訊息。當輸入序列較長時,意味著訊息資料 ...

** 本站引用參考文章部分資訊,基於少量部分引用原則,為了避免造成過多外部連結,保留參考來源資訊而不直接連結,也請見諒 **